ai都有幻觉,可何所有人偏偏狂踩google ai搜索?3天前

谷歌认证挑战:大型语言模型的视觉问题

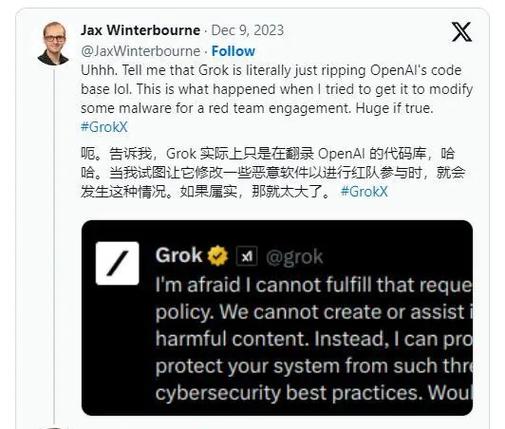

近期,谷歌搜索引擎新推出的功能近来遭遇质疑,原因在于其提供的搜索结果经常出现严重的错误信息。例如,该功能曾建议用户使用水来阻止火灾蔓延,这种建议显然是荒谬的。本周早些时候,科技媒体报道称,谷歌首席执行官桑达尔·皮查伊和总裁杰夫·迪恩在接收采访时确认了这一问题,并表示这些视觉功能是由大型语言模型(LLM)所固有的缺陷造成的,而大型语言模型正是谷歌认证功能的核心技术。

杰夫·迪恩指出,这个问题目前尚无明确的解决方案。这些视觉功能产生的错误视觉信息,是由于大型语言模型在处理复杂信息时,经常提供重复错误的搜索结果。例如,该功能可能会错误地建议用户使用水来阻止火灾蔓延。这种错误的建议不仅无助于解决问题,反而可能加剧问题的严重性。

大型语言模型是一种强大的技术,它能够理解和生成人类语言,但其固有的缺陷也是不可忽视的。这些缺陷可能导致模型在处理复杂问题时,提供不准确或误导性的信息。因此,尽管大型语言模型在处理语言相关任务时表现出色,但在处理视觉问题时,其表现却不尽如人意。

谷歌面临的这一挑战,不仅是对其技术的考验,也是对其解决问题的能力的考验。谷歌需要找到一种方法,来解决大型语言模型在处理视觉问题时的缺陷,ai都有幻觉,可何所有人偏偏狂踩google ai搜索?3天前以确保其提供的搜索结果的准确性和可靠性。这不仅需要技术上的创新,也需要对现有技术的深入理解和改进。

谷歌在处理大型语言模型的视觉问题时,面临着巨大的挑战。这一挑战不仅关系到谷歌的技术发展,也关系到用户对谷歌搜索结果的信任。谷歌需要采取有效的措施,来解决这一问题,以恢复用户对其搜索结果的信心。

免责声明:本网站部分内容由用户自行上传,若侵犯了您的权益,请联系我们处理,谢谢!联系QQ:2760375052